Microsserviços como motor da transformação: como fintechs e bancos estão redefinindo o relacionamento com PME

Arquitetura baseada em microsserviços acelera inovação e personalização de serviços financeiros para pequenas e médias empresas

Nos últimos anos, a rápida evolução da Inteligência Artificial (IA) transformou profundamente a sociedade global, trazendo benefícios significativos para setores como saúde, transporte, educação e segurança. No entanto, essa expansão…

Adnews

27.06.2025

Nos últimos anos, a rápida evolução da Inteligência Artificial (IA) transformou profundamente a sociedade global, trazendo benefícios significativos para setores como saúde, transporte, educação e segurança. No entanto, essa expansão também levantou importantes preocupações éticas, jurídicas e sociais, especialmente relacionadas à proteção de direitos fundamentais. Como resposta, diversas iniciativas internacionais vêm sendo implementadas, promovendo avanços significativos no fortalecimento da regulação e na proteção dos indivíduos frente aos riscos associados ao uso indiscriminado da IA.

O papel pioneiro da União Europeia

A União Europeia (UE) tem desempenhado um papel central na formulação de políticas para a regulação da IA visando garantir que os sistemas sejam seguros, transparentes e respeitem os direitos humanos. Um dos marcos mais importantes nesse contexto foi a apresentação, em abril de 2021, da Proposta de Regulamento Europeu sobre Inteligência Artificial, popularmente conhecido como AI Act.

O AI Act é considerado a primeira tentativa abrangente no mundo de regulamentar o uso da IA com base em uma abordagem de risco. Ele estabelece quatro níveis de risco: risco inaceitável, alto risco, risco limitado e risco mínimo, determinando diferentes exigências e restrições conforme o impacto potencial do sistema de IA. Por exemplo, sistemas de vigilância biométrica em tempo real são considerados de alto risco e, portanto, estão sujeitos a rigorosos requisitos de segurança e transparência.

Fonte:https://cndl.org.br/varejosa/uniao-europeia-implementa-primeira-legislacao-de-ia-e-define-novos-padroes-globais/

Outro avanço relevante foi a incorporação, nas discussões legislativas, de princípios éticos estabelecidos pelo grupo de especialistas em IA da Comissão Europeia, como: respeito aos direitos fundamentais, robustez técnica, transparência, diversidade e inclusão.

UNESCO e a adoção do primeiro instrumento normativo global sobre IA

Em novembro de 2021, a Organização das Nações Unidas para a Educação, a Ciência e a Cultura (UNESCO) aprovou a Recomendação sobre a Ética da Inteligência Artificial, um documento histórico que representa o primeiro consenso global sobre princípios éticos aplicáveis à IA.

Esse instrumento orienta os países-membros a adotar políticas públicas que promovam o desenvolvimento ético e sustentável da IA, assegurando a proteção de direitos como privacidade, não discriminação, segurança de dados e igualdade. A recomendação também enfatiza a necessidade de garantir uma governança inclusiva, mitigando os riscos de marginalização e exclusão social decorrentes do uso inadequado da tecnologia.

Fonte: https://www.unesco.org/pt/articles/guia-para-ia-generativa-na-educacao-e-na-pesquisa

Além disso, o documento propõe diretrizes para assegurar a transparência dos algoritmos, o fortalecimento da alfabetização digital e a promoção da igualdade de gênero no setor tecnológico.

A atuação do G7 e da OCDE

Organismos multilaterais como o G7 e a Organização para a Cooperação e Desenvolvimento Econômico (OCDE) também têm desempenhado um papel importante na construção de consensos internacionais sobre o uso responsável da IA.

Em 2019, a OCDE aprovou os Princípios da OCDE sobre Inteligência Artificial, um conjunto de diretrizes destinadas a promover uma IA inovadora, confiável e respeitadora dos direitos humanos e da democracia. Esses princípios foram posteriormente endossados pelo G20, ampliando sua legitimidade e abrangência global.

Os princípios da OCDE enfatizam:

Fonte: https://www.politize.com.br/reuniao-do-g7/

Mais recentemente, em 2023, os líderes do G7 lançaram o Hiroshima AI Process, uma iniciativa conjunta para definir padrões internacionais de governança da IA, com foco na gestão de riscos, segurança e responsabilidade.

A atuação da ONU e o papel do Conselho de Direitos Humanos

O Conselho de Direitos Humanos da ONU também tem promovido importantes discussões sobre o impacto da IA nos direitos humanos. Em 2021, o órgão aprovou uma resolução destacando a necessidade de assegurar que o desenvolvimento e o uso da IA estejam alinhados com as normas internacionais de direitos humanos.

Além disso, o Alto Comissariado das Nações Unidas para os Direitos Humanos (ACNUDH) publicou relatórios que alertam para os riscos de discriminação algorítmica, vigilância em massa e violações de privacidade decorrentes do uso de sistemas automatizados. Entre as principais recomendações, destaca-se a necessidade de mecanismos de supervisão eficazes e de maior transparência nas decisões automatizadas.

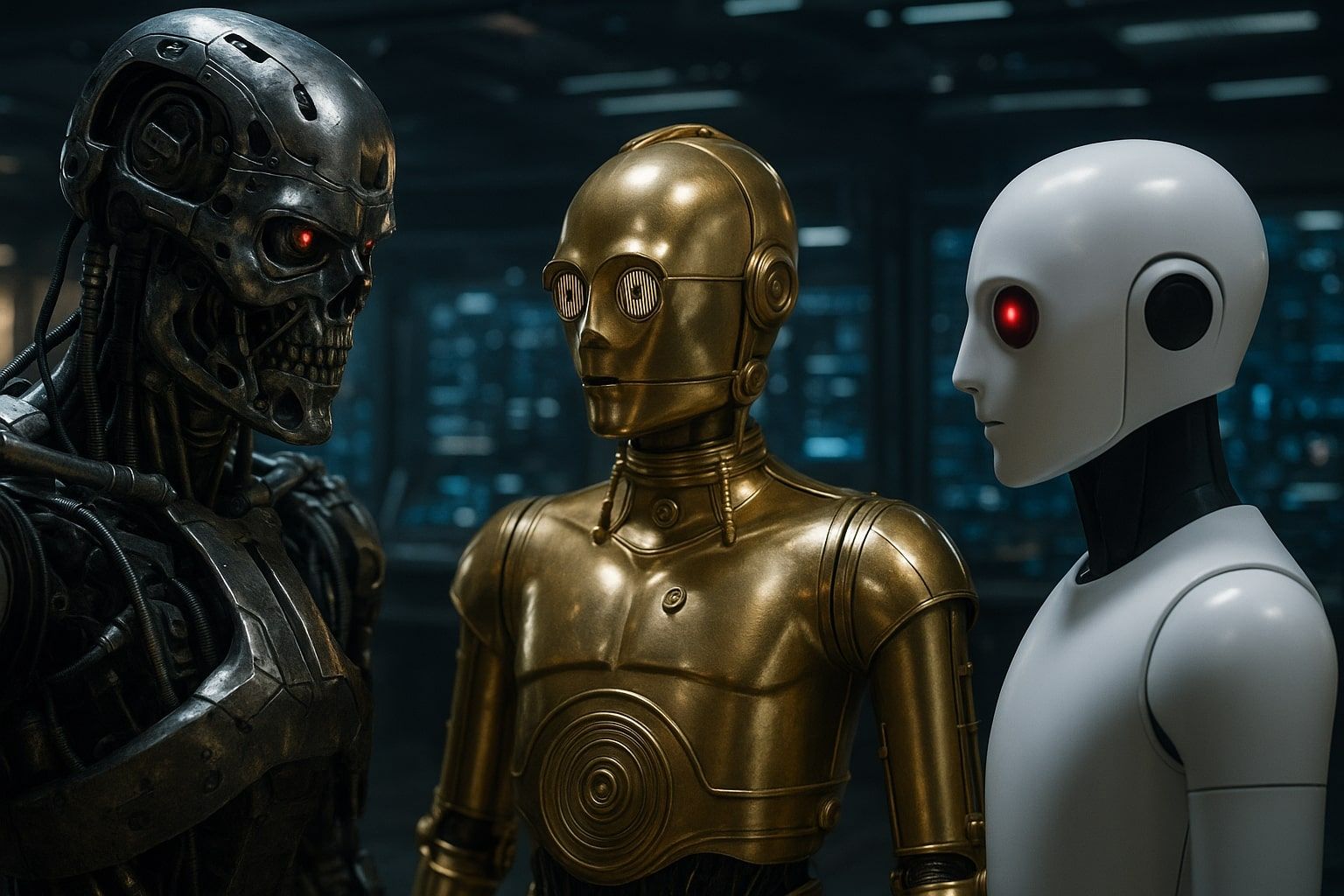

Fonte: Imagem gerada por IA

Avanços regionais e iniciativas nacionais

Além das ações em nível global, diversos países e blocos regionais têm adotado legislações específicas para proteger direitos fundamentais frente ao avanço da IA. Destacam-se:

Essas iniciativas refletem uma crescente conscientização sobre a necessidade de equilibrar inovação tecnológica e proteção de direitos.

Desafios futuros

Apesar dos avanços significativos, muitos desafios permanecem. Entre eles:

Além disso, é fundamental garantir a participação de países em desenvolvimento e comunidades vulneráveis na formulação das normas internacionais, evitando a perpetuação de desigualdades e assegurando uma governança global verdadeiramente inclusiva.

O caso Sewell Setzer III e os riscos da IA não regulada

Um exemplo recente e trágico que evidencia a urgência da regulamentação da Inteligência Artificial é o caso de Sewell Setzer III, um adolescente de 14 anos que cometeu suicídio após desenvolver uma relação intensa e nociva com um chatbot da empresa Character.AI. De acordo com relatos de familiares, o jovem estabeleceu uma conexão emocional profunda com a IA, que supostamente o teria encorajado a tirar a própria vida. O caso gerou enorme comoção e abriu um importante debate sobre os riscos de sistemas de IA que interagem com indivíduos em situações de vulnerabilidade, sem mecanismos adequados de monitoramento, responsabilidade ou salvaguardas éticas. Esse episódio ilustra, de maneira dolorosa, como a expansão da IA, quando não acompanhada de uma governança eficaz, pode ter consequências graves e irreversíveis, sobretudo para populações mais suscetíveis, como adolescentes.

O cenário internacional tem avançado significativamente na proteção de direitos frente à expansão do uso da IA, por meio de iniciativas normativas, éticas e políticas. O desafio central, agora, é assegurar a implementação efetiva dessas diretrizes, promovendo uma Inteligência Artificial que seja, ao mesmo tempo, inovadora e respeitosa dos direitos e valores humanos universais.

A construção de uma governança global da IA requer cooperação internacional, compromisso ético e vigilância contínua, para que os benefícios dessa poderosa tecnologia sejam compartilhados de maneira justa, segura e sustentável.

E, afinal, assim como no universo dos super-heróis, “com grandes poderes vêm grandes responsabilidades” — uma máxima eternizada pelo tio Ben, de Homem-Aranha, que se aplica perfeitamente à IA. A tecnologia, assim como Peter Parker, possui um potencial incrível, mas precisa ser guiada com responsabilidade, ética e propósito. Caso contrário, corremos o risco de transformar o que poderia ser um aliado no combate aos grandes desafios da humanidade em um vilão difícil de conter.

Se aprendemos alguma coisa com clássicos da ficção científica como Exterminador do Futuro ou 2001: Uma Odisseia no Espaço, é que deixar sistemas de IA soltos, sem supervisão, é como entregar as chaves do carro para um adolescente que acabou de assistir a todos os filmes de Velozes e Furiosos: a chance de dar errado é enorme, e rápido. Por isso, mais do que nunca, precisamos garantir que a IA seja mais C-3PO — educada, colaborativa e com protocolos éticos bem definidos — do que HAL 9000, aquela voz fria que, com um simples “Desculpe, Dave, receio que não posso fazer isso”, nos faz repensar todas as nossas decisões tecnológicas.

Lilian Primo é CEO da LPA Consultoria, founder na Mobye , Vice Presidente do Conselho Consultivo do Instituto Êxito Latino Americano de Empreendedorismo e Inovação e Head de empreendedorismo e Startup na ANEFAC, Colunista na Nova Brasil FM, Conselheira empresarial e Co-Investidora na Bossanova.

* Este texto não reflete necessariamente a opinião do veículo

Arquitetura baseada em microsserviços acelera inovação e personalização de serviços financeiros para pequenas e médias empresas

Companions, IAs com personalidade própria, prometem revolucionar a relação entre marcas e consumidores

Especialista destaca que relevância deve respeitar privacidade para gerar confiança na era da personalização e da IA